KnowBe4 Japan合同会社は4月17日、日本国内の企業・団体に勤める従業員を対象に実施した「生成AIの活用とサイバーセキュリティへの影響」に関する意識調査の結果を発表した。

同調査は、生成AIのサイバーセキュリティへの影響をどのように考えているか実態を把握する目的で、生成AIの利用状況や利用者のリスク、その対策について意識調査を実施した。

その結果、生成AIの急速な普及に対する高い期待感と同時に、情報漏洩や著作権侵害などセキュリティリスクへの不安が広がっている現状、そして「人」を軸としたセキュリティのための組織文化の必要性が浮き彫りになった。

調査結果

生成AIの利用状況と活用意向

62%が自組織で生成AIを既に導入しており、73%が今後の利用拡大を見込んでいる。従業員数規模で見ると1000人以上の組織では生成AIを利用している割合が80%であるのに対して、1000人未満の組織では生成AIの利用が46%に留まっており、小規模組織における今後の利用拡大の伸びしろが大きいことが分かった。

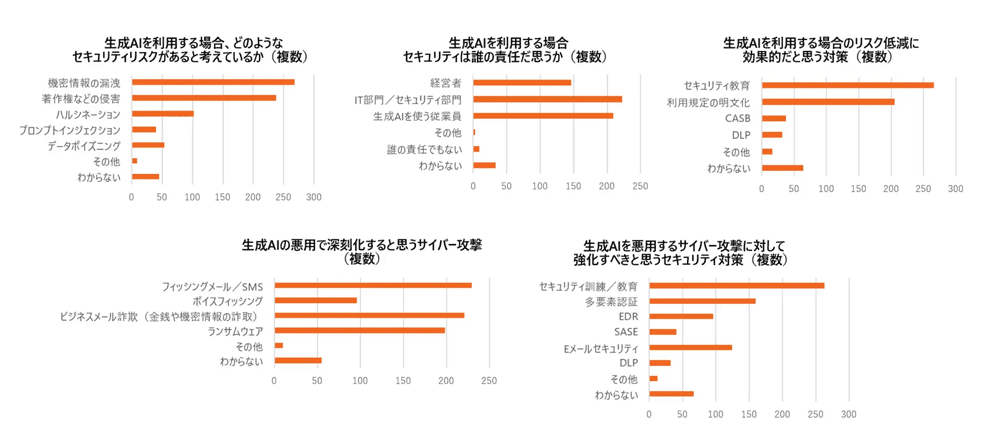

セキュリティリスクの認識と懸念

70%が生成AIにセキュリティリスクを感じており、「機密情報の漏洩」や「著作権侵害」といったヒューマンエラーに起因する「ヒューマンリスク」を主要な懸念として挙げている。

リスク理解の現状

生成AIを利用する際に自組織の従業員がリスクを「理解している」と回答したのは32%で、普及との間に意識差が生じている。1000人以上の組織では「従業員がリスクを理解している」と答えたのは41%だった一方、従業員数1000人未満の組織では24%と全体平均を下回っていた。また、生成AIを利用していない人はリスク判断ができない傾向もみられたことから、生成AIを安全に利用するためにも、組織全体で取り組む意識改革は今後の大きな課題と言える。

セキュリティ責任の所在

当事者意識を問う設問において、セキュリティの責任主体は「組織全体で取り組む課題」として認識されている。特に1000人以上の大規模組織では全体の傾向と同様に「組織に携わる全員の責任」と捉えていたが、1000人未満の小規模組織では「経営者が責任を負うべき」と捉える傾向があった。また、役職別に見ると経営者、役員、本部長は経営サイドにセキュリティの責任があると考えており、部長以下の一般社員は、自分自身やIT/セキュリティ部門に責任があると捉える傾向があった。

AI悪用の脅威認識

生成AIを悪用したサイバー攻撃について、74%が「脅威」と感じており、「フィッシング」や「ビジネスメール詐欺」などソーシャルエンジニアリング系攻撃の高度化が強く懸念されている。

強化すべき対策

脅威への対策としては、ほぼ全ての業種において「セキュリティ訓練/教育」を強化すべきと回答しており、技術もさることながら「人」に対するアプローチを重視する傾向が見られた。

調査結果に基づく考察

今回の調査は、生成AIが企業活動に不可欠な存在になりつつある一方で、セキュリティリスクへの対処が追いついていない現状が浮き彫りになった。生成AIを利用する際のリスクは「人」、つまり「ヒューマンエラー」に起因するものであると多くの人が認識しているものの、組織として「ヒューマンエラー」に対する取り組みは遅れていることが分かった。

生成AIの急速な能力拡大と普及により、ヒューマンリスクへの対応は今後ますます重要な課題となっていきます。ヒューマンエラーやリスクを過度に恐れて生成AIの利用を躊躇し、用途を制限することになっては、現場の創造性や自尊心を損ないかねない。

「人のミス=ヒューマンエラー」であることを組織の課題として、恐れず正しくアプローチするためには、セキュリティを重視する風土や気風、つまり「セキュリティ文化の醸成」が不可欠となる。

[i Magazine・IS magazine]