生成AIは、利用に際して注意すべき点もある。特に重要なのが、ハルシネーションとセキュリティである。仕事で生成AIを使う場合は、この点を正しく理解しておくことが重要で、それが組織全体でAIを安全かつ効果的に活用するための絶対条件となる。

ハルシネーション

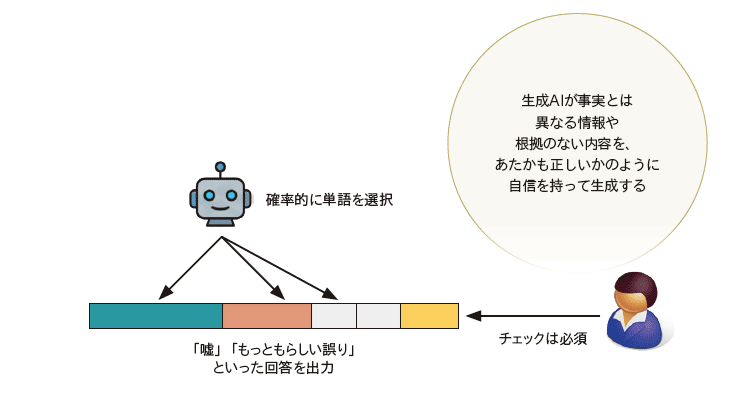

ハルシネーションとは、生成AIが事実に基づかない情報を、あたかも真実であるかのように堂々と生成する現象を指す。「幻覚」という言葉のとおり、AIが学習データのパターンから「それらしい」情報を創作してしまうのである(図表1)。

ただしこれは「02 生成AI」の項でも触れたように、生成AIが、確率論的に高い文書を生成しているにすぎないことを理解すれば、何も不思議なことではない。

たとえば、存在しない関数の使い方を説明したり、歴史上の出来事を不正確に述べたり、もっともらしいが誤った判例を引用したりといったことは、AIを使用する上で誰もが経験しているだろう。

これは生成AIの仕組みに起因する。ハルシネーションによって生成された情報を鵜呑みにしてしまうと、誤った意思決定やプログラムのバグ、信用の失墜につながりかねない。

そもそも、生成AIは意図的に「嘘をついている」わけではなく、また生成した結果が「正しい」のか「正しくない」のかを判断することもできない。

仕事で生成AIを使う場合は、この点を常に意識しておく必要がある。2026年現在、生成AIは、ビジネスでさまざまな決断を行うための最終的な成果物を出力するレベルには至っておらず、生成結果のファクトチェックは常に行うべきであることは言うまでもない。

「04 プロンプトとコンテキスト」の項でも触れたが、必要な情報(5W1H)を常に心がけてプロンプトを作成すれば、間違った結果を生成する確率はかなり下げられるはずだ。「嘘をつくから、生成AIは使えない」と思うのではなく、うまく会話しながら利用できれば、こんなに便利なものはない。

生成AIにまつわるセキュリティリスク

生成AIの利用に関するリスクは、ハルシネーションだけではない。さらに深刻なセキュリティ上のリスクについても理解しておく必要がある。

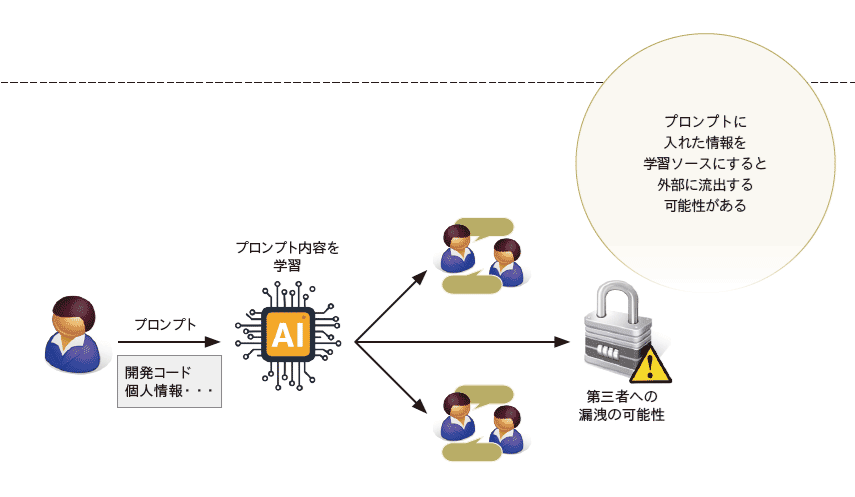

機密情報の漏洩

次の「07 ファインチューニングとRAG」の項で詳しく触れるが、普段我々が使用している大規模言語モデル(LLM)は、さまざまな情報を学習して「賢く」なっていく。LLMがどのタイミングで学習しているのかはそれぞれのモデルによって異なるが、学習ソースはインターネットで公開されている情報である一方、利用者がプロンプトやコンテキストとして渡している情報も同じくソースになりうる可能性がある。

OpenAIやGoogle、Anthropicは常に新しいモデルを発表し続けており、それが無償で利用可能になっているとつい試したくなる。しかしその際、プロンプトに入れた情報が学習ソースになる場合があるので注意が必要である。

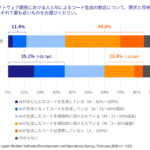

仕事で利用する企業データには開発中のソースコード、個人情報、企業の財務データといった機密情報があり、これをプロンプトとして入力すると、そのデータがAIモデルの学習に利用されたり、第三者に漏洩するリスクがある(図表2)。

このような事態を避けるためにも、仕事でAIサービスを使う場合は細心の注意が必要である。使おうとしているLLMは会社で許可されているのか、利用する場合のアカウントはどれを使うべきか、利用するサービス上で学習させない設定があるかどうかなど、しっかり調べてから利用しなければならない。

IBM i環境での対策と心構え

これらのリスクは、当然ながらIBM i環境でAIを活用する際には特に気をつけるべきだろう。最低限注意すべき事柄を、以下に挙げる。

出力のファクトチェック

AIの生成したコードや情報は、必ず人間の専門家がレビューし、その正しさを検証するプロセスを設けねばならない。

特に既存のソースコードをAIに解析させて修正させる場合は、それがAIの修正だとわかるような仕組みが必須となる(後に述べるGitを参照)。

機密情報の分離

オンプレミス環境で動作するAIモデルや、入力データを学習に使わないことを明記しているエンタープライズ向けのAIサービスを選択し、機密情報が外部に漏れないよう徹底する。

IBM iには基幹システムのプログラムコードや、機密性の高い膨大な基幹業務データが存在する。これらをプロンプトに入力して解析させれば、日々の業務の改善に劇的な効果をもたらす可能性があるが、同時に生成AIに学習されないことを事前に確認しておくべきである。

アクセス制御と監視

AIツールへのアクセス権を適切に管理し、誰が・いつ・どのような目的でAIを利用したかを記録・監視する仕組みを構築する。

生成AIは万能な魔法の杖ではない。その限界とリスクを理解し、人間が賢く管理・監督するという姿勢が、これからのAI時代には不可欠となるだろう。

著者|

小川 誠 氏

ティアンドトラスト株式会社

代表取締役社長 CIO CTO

1989年、エス・イー・ラボ入社。その後、1993年にティアンドトラストに入社。システム/38 から IBM i まで、さまざまな開発プロジェクトに参加。またAS/400 、IBM i の機能拡張に伴い、他プラットフォームとの連携機能開発も手掛ける。IBM i 関連の多彩な教育コンテンツの作成や研修、セミナーなども担当。2021年6月から現職。

新・IBM i入門ガイド [コード生成編]

<基本用語>

01 生成AI&IBM i市場動向

02 生成AI

03 大規模言語モデルとマルチモーダルモデル

04 プロンプトとコンテキスト

05 AIエージェント

06 ハルシネ―ションとセキュリティ

07 ファインチューニングとRAG

08 APIとMCP

<基本ツール>

01 コード生成AIの思考プロセスと主要ツール

02 IBM i開発環境構築ロードマップ

03 Visual Studio Code

04 Code for IBM i

05 Git

06 Markdown

<開発ツール>

01 AIファースト開発環境

02 IBM Bob

03 対話型・CLI型AIツールの戦略的活用術

04 学びを止めないための次の一歩 リンク集

[i Magazine 2026 Spring掲載]